Determinante

In der linearen Algebra ist die Determinante eine Zahl (ein Skalar), die einer quadratischen Matrix zugeordnet wird und aus ihren Einträgen berechnet werden kann. Sie gibt an, wie sich das Volumen bei der durch die Matrix beschriebenen linearen Abbildung ändert, und ist ein nützliches Hilfsmittel bei der Lösung linearer Gleichungssysteme. Allgemeiner kann man jeder linearen Selbstabbildung (Endomorphismus) eine Determinante zuordnen. Übliche Schreibweisen für die Determinante einer quadratischen Matrix sind , oder . ⓘ

Zum Beispiel kann die Determinante einer -Matrix

mit der Formel

berechnet werden. ⓘ

Mit Hilfe von Determinanten kann man beispielsweise feststellen, ob ein lineares Gleichungssystem eindeutig lösbar ist, und kann die Lösung mit Hilfe der Cramerschen Regel explizit angeben. Das Gleichungssystem ist genau dann eindeutig lösbar, wenn die Determinante der Koeffizientenmatrix ungleich null ist. Entsprechend ist eine quadratische Matrix mit Einträgen aus einem Körper genau dann invertierbar, wenn ihre Determinante ungleich null ist. ⓘ

Schreibt man Vektoren im als Spalten einer quadratischen Matrix, so kann die Determinante dieser Matrix gebildet werden. Bilden bei dieser Festlegung die Vektoren eine Basis, so kann das Vorzeichen der Determinante dazu verwendet werden, die Orientierung von euklidischen Räumen zu definieren. Der Absolutbetrag dieser Determinante entspricht zugleich dem Volumen des n-Parallelotops (auch Spat genannt), das durch diese Vektoren aufgespannt wird. ⓘ

Wird die lineare Abbildung durch die Matrix repräsentiert und ist eine beliebige messbare Teilmenge, dann folgt, dass das Volumen von durch gegeben ist. ⓘ

Wird die lineare Abbildung durch die -Matrix repräsentiert und ist eine beliebige messbare Teilmenge, so gilt im Allgemeinen, dass das -dimensionale Volumen von durch gegeben ist, siehe Gramsche Determinante ⓘ

Das Konzept der Determinante ist von Interesse für -Matrizen mit . Für verkommt es zur Trivialität : So besteht ein lineares Gleichungssystem für den Fall aus einer Gleichung . Lösbarkeitskriterium und -strategie für diese Gleichung sind bekannt: Falls , setze . ⓘ

Für eine 3 × 3-Matrix A lautet die Determinante entsprechend

Jede Determinante einer 2 × 2-Matrix in dieser Gleichung wird als Minor der Matrix A bezeichnet. Dieses Verfahren kann erweitert werden, um eine rekursive Definition für die Determinante einer n × n-Matrix zu erhalten, die als Laplace-Erweiterung bekannt ist. ⓘ

Determinanten kommen überall in der Mathematik vor. So wird beispielsweise eine Matrix häufig verwendet, um die Koeffizienten in einem System linearer Gleichungen darzustellen, und Determinanten können zur Lösung dieser Gleichungen verwendet werden (Cramersche Regel), obwohl andere Lösungsmethoden rechnerisch viel effizienter sind. Determinanten werden verwendet, um das charakteristische Polynom einer Matrix zu definieren, dessen Wurzeln die Eigenwerte sind. In der Geometrie wird das vorzeichenbehaftete n-dimensionale Volumen eines n-dimensionalen Parallelepipeds durch eine Determinante ausgedrückt. Diese wird in der Infinitesimalrechnung mit äußeren Differentialformen und der Jacobi-Determinante verwendet, insbesondere bei Variablenwechseln in Mehrfachintegralen. ⓘ

2 × 2-Matrizen

Die Determinante einer 2 × 2-Matrix wird entweder durch "det" oder durch senkrechte Balken um die Matrix herum bezeichnet und ist definiert als

Zum Beispiel,

Erste Eigenschaften

Die Determinante hat mehrere Schlüsseleigenschaften, die sich durch direkte Auswertung der Definition für -Matrizen bewiesen werden können, und die auch für Determinanten größerer Matrizen gelten. Sie lauten wie folgt: Erstens ist die Determinante der Einheitsmatrix ist 1. Zweitens: Die Determinante ist Null, wenn zwei Zeilen gleich sind:

Dies gilt auch, wenn die beiden Spalten gleich sind. Außerdem,

Wenn schließlich eine beliebige Spalte mit einer bestimmten Zahl multipliziert wird multipliziert wird (d. h. alle Einträge in dieser Spalte werden mit dieser Zahl multipliziert), wird auch die Determinante mit dieser Zahl multipliziert:

Geometrische Bedeutung

Wenn die Matrixeinträge reelle Zahlen sind, kann die Matrix A dazu verwendet werden, zwei lineare Abbildungen darzustellen: eine, die die Standardbasisvektoren auf die Zeilen von A abbildet, und eine, die sie auf die Spalten von A abbildet. In beiden Fällen bilden die Bilder der Basisvektoren ein Parallelogramm, das das Bild des Einheitsquadrats unter der Abbildung darstellt. Das Parallelogramm, das durch die Zeilen der obigen Matrix definiert ist, hat die Eckpunkte (0, 0), (a, b), (a + c, b + d) und (c, d), wie in der nebenstehenden Abbildung gezeigt. ⓘ

Der Absolutwert von ad - bc ist der Flächeninhalt des Parallelogramms und stellt somit den Skalierungsfaktor dar, um den die Flächen durch A transformiert werden. (Das Parallelogramm, das durch die Spalten von A gebildet wird, ist im Allgemeinen ein anderes Parallelogramm, aber da die Determinante symmetrisch in Bezug auf Zeilen und Spalten ist, ist der Flächeninhalt derselbe). ⓘ

Der Absolutwert der Determinante ergibt zusammen mit dem Vorzeichen die orientierte Fläche des Parallelogramms. Die orientierte Fläche ist dieselbe wie die gewöhnliche Fläche, nur dass sie negativ ist, wenn der Winkel zwischen dem ersten und dem zweiten Vektor, der das Parallelogramm definiert, im Uhrzeigersinn verläuft (was der Richtung entgegengesetzt ist, die man für die Identitätsmatrix erhalten würde). ⓘ

Um zu zeigen, dass ad - bc der vorzeichenbehaftete Flächeninhalt ist, kann man eine Matrix mit zwei Vektoren u ≡ (a, b) und v ≡ (c, d) betrachten, die die Seiten des Parallelogramms darstellen. Die vorzeichenbehaftete Fläche kann als |u| |v| sin θ für den Winkel θ zwischen den Vektoren ausgedrückt werden, was einfach Basis mal Höhe ist, die Länge des einen Vektors mal die senkrechte Komponente des anderen. Wegen des Sinus ist dies bereits die vorzeichenbehaftete Fläche, doch lässt sie sich bequemer durch den Kosinus des Komplementärwinkels zu einem senkrechten Vektor ausdrücken, z. B. u⊥ = (-b, a), so dass |u⊥| |v| cos θ′, was nach dem Muster des Skalarprodukts gleich ad - bc ist:

Die Determinante gibt also den Skalierungsfaktor und die Orientierung an, die durch die durch A dargestellte Abbildung induziert werden. Wenn die Determinante gleich 1 ist, ist die durch die Matrix definierte lineare Abbildung gleichwichtig und orientierungserhaltend. ⓘ

Das Objekt, das als Bivektor bekannt ist, ist mit diesen Ideen verbunden. In 2D kann er als ein orientiertes Ebenensegment interpretiert werden, das durch die Vorstellung von zwei Vektoren mit dem Ursprung (0, 0) und den Koordinaten (a, b) und (c, d) gebildet wird. Der Betrag des Bivektors (bezeichnet durch (a, b) ∧ (c, d)) ist die vorzeichenbehaftete Fläche, die auch die Determinante ad - bc ist. ⓘ

Wird eine n × n reelle Matrix A in Form ihrer Spaltenvektoren geschrieben , dann

Dies bedeutet, dass den Einheitswürfel n auf das n-dimensionale Parallelotop abbildet, das durch die Vektoren den Bereich ⓘ

Die Determinante gibt das vorzeichenbehaftete n-dimensionale Volumen dieses Parallelotops an, und beschreibt somit ganz allgemein den n-dimensionalen Volumenskalierungsfaktor der von A erzeugten linearen Transformation. (Das Vorzeichen gibt an, ob die Transformation die Orientierung beibehält oder umkehrt.) Insbesondere, wenn die Determinante Null ist, hat dieses Parallelotop ein Volumen von Null und ist nicht vollständig n-dimensional, was bedeutet, dass die Dimension des Bildes von A kleiner als n ist. Das bedeutet, dass A eine lineare Transformation erzeugt, die weder onto noch eineindeutig und somit nicht invertierbar ist. ⓘ

Definition

In der Folge ist A eine quadratische Matrix mit n Zeilen und n Spalten, so dass sie wie folgt geschrieben werden kann

Die Einträge usw. sind für viele Zwecke reelle oder komplexe Zahlen. Wie weiter unten erläutert, ist die Determinante auch für Matrizen definiert, deren Einträge Elemente in abstrakteren algebraischen Strukturen sind, die als kommutative Ringe bezeichnet werden. ⓘ

Die Determinante von A wird mit det(A) bezeichnet, oder sie kann direkt in Bezug auf die Matrixeinträge angegeben werden, indem man statt Klammern umschließende Balken schreibt:

Es gibt verschiedene äquivalente Möglichkeiten, die Determinante einer quadratischen Matrix A zu definieren, d. h. einer Matrix mit der gleichen Anzahl von Zeilen und Spalten: Die Determinante kann über die Leibniz-Formel definiert werden, eine explizite Formel, die Summen von Produkten bestimmter Einträge der Matrix beinhaltet. Die Determinante kann auch als die einzige Funktion charakterisiert werden, die von den Einträgen der Matrix abhängt, die bestimmte Eigenschaften erfüllen. Dieser Ansatz kann auch zur Berechnung von Determinanten durch Vereinfachung der betreffenden Matrizen verwendet werden. ⓘ

Leibniz-Formel

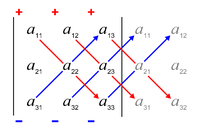

Die Leibniz-Formel für die Determinante einer 3 × 3-Matrix lautet wie folgt:

Die Regel von Sarrus ist eine Gedächtnisstütze für diese Formel: die Summe der Produkte der drei diagonalen Zeilen der Matrixelemente von Nordwest nach Südost minus die Summe der Produkte der drei diagonalen Zeilen der Elemente von Südwest nach Nordost, wenn die Kopien der ersten beiden Spalten der Matrix wie in der Abbildung daneben geschrieben werden:

Dieses Schema zur Berechnung der Determinante einer 3 × 3-Matrix lässt sich nicht auf höhere Dimensionen übertragen. ⓘ

n × n-Matrizen

Die Leibniz-Formel drückt die Determinante einer -Matrix auf eine Weise, die in höheren Dimensionen konsistent ist. ⓘ

Sie ist ein Ausdruck, der den Begriff der Permutationen und deren Signatur beinhaltet. Eine Permutation der Menge ist eine Funktion die diese Menge ganzer Zahlen neu ordnet. Der Wert an der -Stelle nach der Umordnung wird bezeichnet mit . Die Menge aller solcher Permutationen, die so genannte symmetrische Gruppe, wird als . Die Signatur von ist definiert als wenn die Umordnung, die durch durch das aufeinanderfolgende Vertauschen von zwei Einträgen mit einer geraden Anzahl von Vertauschungen erreicht werden kann, und immer dann, wenn sie durch eine ungerade Anzahl solcher Vertauschungen erreicht werden kann. ⓘ

Gegeben eine Permutation und einer -Matrix , wobei das Element in der -ten Zeile und -Spalte von bezeichnet, das Produkt

- ,

auch kürzer geschrieben in der Pi-Notation als

- ,

wird verwendet, um die Determinante mit Hilfe der Leibniz-Formel zu definieren:

- . ⓘ

Die folgende Tabelle wickelt diese Terme für den Fall . In der ersten Spalte ist eine Permutation nach ihren Werten aufgelistet. In der zweiten Zeile ist zum Beispiel die Permutation erfüllt . Sie kann aus der Standardordnung (1, 2, 3) durch einen einzigen Austausch (Vertauschen des zweiten und dritten Eintrags) erhalten werden, so dass ihre Signatur lautet . ⓘ

| Permutation | ||

|---|---|---|

| 1, 2, 3 | ||

| 1, 3, 2 | ||

| 3, 1, 2 | ||

| 3, 2, 1 | ||

| 2, 3, 1 | ||

| 2, 1, 3 |

Die Summe der sechs Terme in der dritten Spalte lautet dann ⓘ

Dies ergibt die Formel für -Matrizen zurück. Für eine allgemeine -Matrix enthält die Leibniz-Formel (n faktorielle) Summanden, von denen jeder ein Produkt von n Einträgen der Matrix ist. ⓘ

Die Leibniz-Formel kann auch durch eine Summation ausgedrückt werden, bei der nicht nur Permutationen, sondern alle Folgen von Indizes im Bereich vorkommen. Dazu verwendet man das Levi-Civita-Symbol anstelle des Vorzeichens einer Permutation

Damit erhält man die obige Formel zurück, da das Levi-Civita-Symbol Null ist, wenn die Indizes keine Permutation bilden. ⓘ

Eigenschaften der Determinante

Charakterisierung der Determinante

Die Determinante kann durch die folgenden drei Schlüsseleigenschaften charakterisiert werden. Um diese anzugeben, ist es zweckmäßig, eine -Matrix A als bestehend aus ihren Spalten zu betrachten, also bezeichnet als

wobei der Spaltenvektor (für jedes i) aus den Einträgen der Matrix in der i-ten Spalte zusammengesetzt ist. ⓘ

- , wobei ist eine Identitätsmatrix.

- Die Determinante ist multilinear: Wenn die j-te Spalte einer Matrix als Linearkombination geschrieben wird von zwei Spaltenvektoren v und w und einer Zahl r geschrieben wird, dann ist die Determinante von A als eine ähnliche Linearkombination ausdrückbar:

- Die Determinante ist alternierend: Immer wenn zwei Spalten einer Matrix identisch sind, ist ihre Determinante 0:

Wenn die Determinante wie oben durch die Leibniz-Formel definiert ist, können diese drei Eigenschaften durch direkte Betrachtung der Formel bewiesen werden. Einige Autoren nähern sich der Determinante auch direkt über diese drei Eigenschaften: Es kann gezeigt werden, dass es genau eine Funktion gibt, die einer beliebigen -Matrix A eine Zahl zuweist, die diese drei Eigenschaften erfüllt. Dies zeigt auch, dass diese abstraktere Herangehensweise an die Determinante die gleiche Definition liefert wie diejenige, die die Leibniz-Formel verwendet. ⓘ

Um dies zu sehen, genügt es, die Determinante durch Multilinearität in den Spalten zu einer (großen) Linearkombination von Determinanten von Matrizen zu erweitern, bei denen jede Spalte ein Standard-Basisvektor ist. Diese Determinanten sind entweder 0 (durch Eigenschaft 9) oder ±1 (durch Eigenschaften 1 und 12 unten), so dass die Linearkombination den obigen Ausdruck in Form des Levi-Civita-Symbols ergibt. Obwohl diese Charakterisierung weniger technisch aussieht, kann sie die Leibniz-Formel bei der Definition der Determinante nicht vollständig ersetzen, da ohne sie die Existenz einer geeigneten Funktion nicht klar ist. ⓘ

Unmittelbare Konsequenzen

Aus diesen Regeln ergeben sich mehrere weitere Konsequenzen:

- Die Determinante ist eine homogene Funktion, d.h., (für eine Matrix ).

- Das Vertauschen eines beliebigen Paares von Spalten einer Matrix multipliziert deren Determinante mit -1. Dies folgt daraus, dass die Determinante multilinear und alternierend ist (Eigenschaften 2 und 3 oben): Diese Formel kann iterativ angewandt werden, wenn mehrere Spalten vertauscht werden. Zum BeispielNoch allgemeiner ausgedrückt: Jede Permutation der Spalten multipliziert die Determinante mit dem Vorzeichen der Permutation.

- Wenn eine Spalte als Linearkombination der anderen Spalten ausgedrückt werden kann (d. h. die Spalten der Matrix bilden eine linear abhängige Menge), ist die Determinante 0. Als Sonderfall gilt: Wenn eine Spalte so beschaffen ist, dass alle ihre Einträge Null sind, dann ist die Determinante dieser Matrix 0.

- Addiert man ein skalares Vielfaches einer Spalte zu einer anderen Spalte, ändert sich der Wert der Determinante nicht. Dies ist eine Folge der Multilinearität und des Alternierens: Durch die Multilinearität ändert sich die Determinante um ein Vielfaches der Determinante einer Matrix mit zwei gleichen Spalten, deren Determinante 0 ist, da die Determinante alternierend ist.

- Wenn eine Dreiecksmatrix ist, d.h. wenn oder, alternativ, wenn ist, dann ist ihre Determinante gleich dem Produkt der Diagonaleinträge: In der Tat kann eine solche Matrix durch geeignete Addition von Vielfachen der Spalten mit weniger Nicht-Null-Einträgen zu denen mit mehr Einträgen zu einer Diagonalmatrix reduziert werden (ohne Änderung der Determinante). Für eine solche Matrix reduziert sich die Linearität in jeder Spalte auf die Identitätsmatrix, und in diesem Fall gilt die angegebene Formel durch die allererste charakterisierende Eigenschaft der Determinanten. Alternativ kann diese Formel auch aus der Leibniz-Formel abgeleitet werden, da die einzige Permutation die einen Beitrag ungleich Null liefert, die Identitätspermutation ist. ⓘ

Beispiel

Diese oben aufgeführten charakterisierenden Eigenschaften und ihre Konsequenzen sind nicht nur theoretisch von Bedeutung, sondern können auch zur Berechnung von Determinanten für konkrete Matrizen verwendet werden. Die Gaußsche Eliminierung kann nämlich angewandt werden, um eine beliebige Matrix in die obere Dreiecksform zu bringen, wobei die Schritte dieses Algorithmus die Determinante auf kontrollierte Weise beeinflussen. Das folgende konkrete Beispiel veranschaulicht die Berechnung der Determinante der Matrix unter Verwendung dieser Methode:

| Matrix |

|

|

| |

| Erhält man durch |

Addieren der zweiten Spalte zur ersten |

3 mal die dritte Spalte zur zweiten addiert |

Vertauschen der ersten beiden Spalten |

Hinzufügen von mal die zweite Spalte zur ersten |

| Determinante |

|

|

|

Die Kombination dieser Gleichungen ergibt ⓘ

Transponieren

Die Determinante der Transponierten von ist gleich der Determinante von A:

- .

Dies kann durch Einsichtnahme in die Leibniz-Formel bewiesen werden. Dies impliziert, dass in allen oben genannten Eigenschaften das Wort "Spalte" durchgehend durch "Zeile" ersetzt werden kann. Betrachtet man zum Beispiel eine n × n-Matrix als aus n Zeilen zusammengesetzt, so ist die Determinante eine n-lineare Funktion. ⓘ

Multiplikativität und Matrixgruppen

Die Determinante ist also eine multiplikative Abbildung, d. h. für quadratische Matrizen und gleicher Größe ist die Determinante eines Matrixprodukts gleich dem Produkt ihrer Determinanten:

Diese wichtige Tatsache kann durch die Beobachtung bewiesen werden, dass für eine feste Matrix beide Seiten der Gleichung alternierend und multilinear sind, und zwar als Funktion in Abhängigkeit von den Spalten von . Außerdem nehmen sie beide den Wert wenn die Identitätsmatrix ist. Die oben erwähnte eindeutige Charakterisierung alternierender multilinearer Karten zeigt also diese Behauptung. ⓘ

Eine Matrix ist genau dann invertierbar, wenn ihre Determinante ungleich Null ist. Dies folgt aus der Multiplikativität von und der unten erwähnten Formel für die Inverse mit der adjungierten Matrix. In diesem Fall ist die Determinante der inversen Matrix gegeben durch

- . ⓘ

Insbesondere haben Produkte und Umkehrungen von Matrizen mit einer Determinante ungleich Null (bzw. Determinante Eins) diese Eigenschaft. Daher bildet die Menge solcher Matrizen (mit fester Größe ) eine Gruppe, die als allgemeine lineare Gruppe (bzw. eine Untergruppe, die spezielle lineare Gruppe . Allgemeiner ausgedrückt, bezeichnet das Wort "speziell" die Untergruppe einer anderen Matrixgruppe von Matrizen der Determinante eins. Beispiele sind die spezielle orthogonale Gruppe (die, wenn n 2 oder 3 ist, aus allen Rotationsmatrizen besteht) und die spezielle unitäre Gruppe. ⓘ

Die Cauchy-Binet-Formel ist eine Verallgemeinerung dieser Produktformel für rechteckige Matrizen. Diese Formel kann auch in eine multiplikative Formel für zusammengesetzte Matrizen umgewandelt werden, deren Einträge die Determinanten aller quadratischen Untermatrizen einer gegebenen Matrix sind. ⓘ

Laplace-Erweiterung

Die Laplace-Erweiterung drückt die Determinante einer Matrix in Form von Determinanten kleinerer Matrizen ausgedrückt, die als ihre Minoren bezeichnet werden. Der Minor ist definiert als die Determinante der -Matrix, die sich aus durch Entfernen der -Zeile und der -Spalte ergibt. Der Ausdruck wird als Kofaktor bezeichnet. Für jede hat man die Gleichheit

was als Laplace-Entwicklung entlang der i-ten Zeile bezeichnet wird. Zum Beispiel ergibt die Laplace-Entwicklung entlang der ersten Zeile () die folgende Formel:

Durch Abspulen der Determinanten dieser -Matrizen erhält man die oben erwähnte Leibniz-Formel zurück. In ähnlicher Weise ergibt die Laplace-Entwicklung entlang der -Spalte die Gleichheit

Die Laplace-Erweiterung kann iterativ zur Berechnung der Determinanten verwendet werden, aber dieser Ansatz ist für große Matrizen ineffizient. Sie ist jedoch nützlich für die Berechnung der Determinanten hochsymmetrischer Matrizen wie der Vandermonde-Matrix

Adjugierte Matrix

Die adjugierte Matrix ist die Transponierte der Matrix der Kofaktoren, d.h.,

Für jede Matrix gilt

Die Adjugationsmatrix kann also verwendet werden, um die Inverse einer nichtsingulären Matrix auszudrücken:

Blockmatrizen

Die Formel für die Determinante einer -Matrix gilt unter geeigneten weiteren Annahmen auch für eine Blockmatrix, d.h. eine Matrix, die aus vier Submatrizen der Dimension , , und zusammensetzt. Die einfachste solche Formel, die entweder mit der Leibniz-Formel oder einer Faktorisierung mit dem Schur-Komplement bewiesen werden kann, ist

Wenn invertierbar ist (und in ähnlicher Weise, wenn invertierbar ist), hat man ⓘ

Wenn ist eine -Matrix ist, vereinfacht sich dies zu . ⓘ

Wenn die Blöcke quadratische Matrizen der gleichen Größe sind, gelten weitere Formeln. Zum Beispiel, wenn und kommutieren (d.h., ), dann gilt ⓘ

Diese Formel wurde auf Matrizen verallgemeinert, die aus mehr als Blöcken zusammengesetzten Matrizen verallgemeinert, wiederum unter geeigneten Kommutativitätsbedingungen zwischen den einzelnen Blöcken. ⓘ

Für und gilt die folgende Formel (auch wenn und nicht kommutativ sind)

Sylvesters Determinanten-Theorem

Das Sylvestersche Determinantensatz besagt, dass für A, eine m × n-Matrix, und B, eine n × m-Matrix (so dass A und B Dimensionen haben, die es erlauben, sie in beliebiger Reihenfolge zu multiplizieren und eine quadratische Matrix zu bilden):

wobei Im und In die m × m bzw. n × n Identitätsmatrizen sind. ⓘ

Aus diesem allgemeinen Ergebnis ergeben sich mehrere Konsequenzen.

- Für den Fall eines Spaltenvektors c und eines Zeilenvektors r mit jeweils m Komponenten ermöglicht die Formel die schnelle Berechnung der Determinante einer Matrix, die sich von der Identitätsmatrix durch eine Matrix vom Rang 1 unterscheidet:

- Allgemeiner ausgedrückt, für jede invertierbare m × m-Matrix X,

- Für einen Spalten- und Zeilenvektor wie oben:

- Für quadratische Matrizen und der gleichen Größe haben die Matrizen und die gleichen charakteristischen Polynome (also die gleichen Eigenwerte). ⓘ

Summe

Die Determinante der Summe zweier gleich großer quadratischer Matrizen lässt sich im Allgemeinen nicht durch die Determinanten von A und B ausdrücken. Für positiv semidefinite Matrizen , und von gleicher Größe,

Summenidentität für 2×2-Matrizen

Für den speziellen Fall von Matrizen mit komplexen Einträgen kann die Determinante der Summe in Form von Determinanten und Spuren in der folgenden Identität geschrieben werden:

Dies lässt sich zeigen, indem man jeden Term in Komponenten ausschreibt . Die linke Seite ist

Durch Expandieren erhält man

Die Terme, die quadratisch sind in sind, werden gesehen als und in ähnlicher Weise für , so dass der Ausdruck geschrieben werden kann

Wir können dann die Querterme schreiben als

die man erkennen kann als

was den Beweis vervollständigt. ⓘ

Dies hat eine Anwendung auf Matrixalgebren. Betrachten wir zum Beispiel die komplexen Zahlen als Matrixalgebra. Die komplexen Zahlen haben eine Darstellung als Matrizen der Form

Dieses Ergebnis folgt einfach aus und . ⓘ

Eigenschaften der Determinante im Verhältnis zu anderen Begriffen

Eigenwerte und charakteristisches Polynom

Die Determinante steht in enger Beziehung zu zwei anderen zentralen Begriffen der linearen Algebra, den Eigenwerten und dem charakteristischen Polynom einer Matrix. Sei sei eine -Matrix mit komplexen Einträgen und Eigenwerten . (Darunter ist zu verstehen, dass ein Eigenwert mit der algebraischen Vielfachheit μ mal in dieser Liste vorkommt.) Dann ist die Determinante von A das Produkt aller Eigenwerte,

Das Produkt aller Eigenwerte, die nicht Null sind, wird als Pseudodeterminante bezeichnet. ⓘ

Das charakteristische Polynom ist definiert als

hier, die Unbestimmtheit des Polynoms und ist die Identitätsmatrix mit der gleichen Größe wie . Mit Hilfe dieses Polynoms lassen sich mit Hilfe der Determinanten die Eigenwerte der Matrix zu finden: Sie sind genau die Wurzeln dieses Polynoms, d.h. die komplexen Zahlen derart, dass

Eine hermitesche Matrix ist positiv definit, wenn alle ihre Eigenwerte positiv sind. Das Sylvester-Kriterium besagt, dass dies gleichbedeutend damit ist, dass die Determinanten der Submatrizen

positiv sind, für alle zwischen und . ⓘ

Trace

Die Spur tr(A) ist per Definition die Summe der Diagonaleinträge von A und entspricht ebenfalls der Summe der Eigenwerte. Daher gilt für komplexe Matrizen A,

oder für reelle Matrizen A,

Hier bezeichnet exp(A) das Matrixexponential von A, denn jeder Eigenwert λ von A entspricht dem Eigenwert exp(λ) von exp(A). Insbesondere ist bei einem beliebigen Logarithmus von A, d. h. einer beliebigen Matrix L, die folgende Bedingungen erfüllt

ist die Determinante von A gegeben durch

Zum Beispiel für n = 2, n = 3 bzw. n = 4,

vgl. Cayley-Hamilton-Theorem. Solche Ausdrücke lassen sich aus kombinatorischen Argumenten, den Newtonschen Identitäten oder dem Faddeev-LeVerrier-Algorithmus ableiten. Das heißt, für generisches n ist detA = (-1)nc0 der vorzeichenbehaftete konstante Term des charakteristischen Polynoms, bestimmt rekursiv aus

Im allgemeinen Fall lässt sich dies auch aus

wobei die Summe über die Menge aller ganzen Zahlen kl ≥ 0 genommen wird, die die Gleichung

Die Formel kann in Form des vollständigen exponentiellen Bell-Polynoms mit n Argumenten sl = -(l - 1)! tr(Al) ausgedrückt werden als

Diese Formel kann auch verwendet werden, um die Determinante einer Matrix AIJ mit mehrdimensionalen Indizes I = (i1, i2, ..., ir) und J = (j1, j2, ..., jr) zu bestimmen. Das Produkt und die Spur solcher Matrizen sind auf natürliche Weise definiert als

Eine wichtige Identität beliebiger Dimension n lässt sich aus der Mercatorreihenentwicklung des Logarithmus ableiten, wenn die Entwicklung konvergiert. Wenn jeder Eigenwert von A im Absolutwert kleiner als 1 ist,

wobei I die Identitätsmatrix ist. Allgemeiner ausgedrückt, wenn

als formale Potenzreihe in s expandiert wird, dann sind alle Koeffizienten von sm für m > n Null und das verbleibende Polynom ist det(I + sA). ⓘ

Obere und untere Schranken

Für eine positiv definite Matrix A liefert der Spuroperator die folgenden engen unteren und oberen Schranken für die logarithmische Determinante

Diese Beziehung kann über die Formel für die KL-Divergenz zwischen zwei multivariaten Normalverteilungen abgeleitet werden. ⓘ

Außerdem,

Diese Ungleichungen können bewiesen werden, indem man die Spuren und die Determinante in Form von Eigenwerten ausdrückt. Sie entsprechen der bekannten Tatsache, dass das harmonische Mittel kleiner ist als das geometrische Mittel, das wiederum kleiner ist als das arithmetische Mittel, das wiederum kleiner ist als der quadratische Mittelwert. ⓘ

Ableitung

Die Leibniz-Formel zeigt, dass die Determinante von reellen (oder analog für komplexe) quadratischen Matrizen eine Polynomfunktion von zu . Insbesondere ist sie überall differenzierbar. Ihre Ableitung kann mit der Jacobi-Formel ausgedrückt werden:

wobei die Adjugierte von . Insbesondere, wenn invertierbar ist, haben wir ⓘ

Ausgedrückt in Form der Einträge von ausgedrückt, sind dies ⓘ

Eine weitere äquivalente Formulierung ist ⓘ

- , ⓘ

unter Verwendung der Big-O-Schreibweise. Der Spezialfall, in dem , die Identitätsmatrix, ergibt ⓘ

Diese Identität wird bei der Beschreibung von Lie-Algebren verwendet, die mit bestimmten Matrix-Lie-Gruppen verbunden sind. Zum Beispiel ist die spezielle lineare Gruppe ist definiert durch die Gleichung . Die obige Formel zeigt, dass ihre Lie-Algebra die spezielle lineare Lie-Algebra ist, die aus den Matrizen mit der Spur Null besteht. ⓘ

Schreibt man eine -Matrix als wobei sind Spaltenvektoren der Länge 3, dann kann der Gradient über einen der drei Vektoren als das Kreuzprodukt der beiden anderen geschrieben werden:

Geschichte

Historisch gesehen wurden Determinanten schon lange vor Matrizen verwendet: Eine Determinante wurde ursprünglich als eine Eigenschaft eines Systems linearer Gleichungen definiert. Die Determinante "bestimmt", ob das System eine eindeutige Lösung hat (was genau dann der Fall ist, wenn die Determinante ungleich Null ist). In diesem Sinne wurden Determinanten erstmals im chinesischen Mathematiklehrbuch Die neun Kapitel über die mathematische Kunst (九章算術, chinesische Gelehrte, um das 3. Jahrhundert v. Chr.) verwendet. In Europa wurden die Lösungen von linearen Systemen aus zwei Gleichungen von Cardano im Jahr 1545 durch eine determinantenähnliche Einheit ausgedrückt. ⓘ

Die Determinanten selbst stammen aus den Arbeiten von Seki Takakazu (1683) in Japan und parallel dazu von Leibniz (1693). Cramer (1750) stellte die Cramersche Regel auf, ohne sie zu beweisen. Sowohl Cramer als auch Bezout (1779) wurden durch die Frage nach ebenen Kurven, die durch eine gegebene Menge von Punkten verlaufen, zu Determinanten geführt. ⓘ

Vandermonde (1771) erkannte Determinanten erstmals als unabhängige Funktionen. Laplace (1772) gab die allgemeine Methode der Erweiterung einer Determinante in Bezug auf ihre komplementären Minoren: Vandermonde hatte bereits einen Spezialfall angegeben. Unmittelbar danach behandelte Lagrange (1773) Determinanten zweiter und dritter Ordnung und wandte sie auf Fragen der Eliminierungstheorie an; er bewies viele Spezialfälle der allgemeinen Identitäten. ⓘ

Gauß (1801) machte den nächsten Schritt. Wie Lagrange machte er viel Gebrauch von Determinanten in der Zahlentheorie. Er führte das Wort "Determinante" ein (Laplace hatte "Resultante" verwendet), wenn auch nicht in der heutigen Bedeutung, sondern eher als Anwendung auf die Diskriminante eines Quants. Gauß führte auch den Begriff der reziproken (inversen) Determinanten ein und kam dem Multiplikationssatz sehr nahe. ⓘ

Der nächste wichtige Beitrag stammt von Binet (1811, 1812), der den Satz über das Produkt zweier Matrizen mit m Spalten und n Zeilen formell formulierte, der für den Spezialfall m = n auf den Multiplikationssatz zurückgeht. Am selben Tag (30. November 1812), an dem Binet seine Arbeit der Akademie vorstellte, legte auch Cauchy eine Arbeit zu diesem Thema vor. (Siehe Cauchy-Binet-Formel.) Darin verwendet er das Wort "Determinante" in seiner heutigen Bedeutung, fasst zusammen und vereinfacht, was damals zu diesem Thema bekannt war, verbessert die Notation und gibt das Multiplikationstheorem mit einem Beweis, der zufriedenstellender ist als der von Binet. Mit ihm beginnt die Theorie in ihrer Allgemeinheit. ⓘ

(Jacobi 1841) verwendet die funktionale Determinante, die Sylvester später Jacobian nennt. In seinen Erinnerungen in Crelle's Journal für 1841 behandelt er speziell dieses Thema, sowie die Klasse der alternierenden Funktionen der Sylvester hat als alternants. Über die Zeit der Jacobi's letzten Erinnerungen, Sylvester (1839) und Cayley begann ihre Arbeit. Cayley führte 1841 die moderne Notation für die Determinante mit vertikalen Balken ein. ⓘ

Die Untersuchung spezieller Formen von Determinanten war das natürliche Ergebnis der Vervollständigung der allgemeinen Theorie. Achsensymmetrische Determinanten wurden von Lebesgue, Hesse und Sylvester untersucht; persymmetrische Determinanten von Sylvester und Hankel; Zirkulanten von Catalan, Spottiswoode, Glaisher und Scott; schiefe Determinanten und Pfaffianer, in Verbindung mit der Theorie der orthogonalen Transformation, von Cayley; Kontinuitäten von Sylvester; Wronskianer (von Muir so genannt) von Christoffel und Frobenius; zusammengesetzte Determinanten von Sylvester, Reiss und Picquet; Jacobianer und Hessianer von Sylvester; und symmetrische Gauche-Determinanten von Trudi. Von den Lehrbüchern zu diesem Thema war das von Spottiswoode das erste. In Amerika veröffentlichten Hanus (1886), Weld (1893) und Muir/Metzler (1933) Abhandlungen. ⓘ

Anwendungen

Die Cramersche Regel

Determinanten können verwendet werden, um die Lösungen eines linearen Gleichungssystems zu beschreiben, das in Matrixform geschrieben wird als . Diese Gleichung hat eine eindeutige Lösung wenn und nur wenn ungleich Null ist. In diesem Fall ist die Lösung durch die Cramersche Regel gegeben:

wobei ist die Matrix, die durch Ersetzen der -Spalte von durch den Spaltenvektor . Dies folgt unmittelbar aus der Spaltenerweiterung der Determinante, d.h.

wobei die Vektoren die Spalten von A sind. Die Regel wird auch durch die Identität impliziert ⓘ

Die Cramersche Regel kann implementiert werden in Zeit implementiert werden, was vergleichbar ist mit gebräuchlicheren Methoden zur Lösung von linearen Gleichungssystemen, wie LU, QR oder Singulärwertzerlegung. ⓘ

Lineare Unabhängigkeit

Determinanten können verwendet werden, um linear abhängige Vektoren zu charakterisieren: Die Determinante ist nur dann Null, wenn die Spaltenvektoren (oder, äquivalent dazu, die Zeilenvektoren) der Matrix linear abhängig sind. Bei zwei linear unabhängigen Vektoren zum Beispiel ein dritter Vektor genau dann in der Ebene, die von den beiden erstgenannten Vektoren aufgespannt wird, wenn die Determinante der -Matrix, die aus den drei Vektoren besteht, Null ist. Der gleiche Gedanke wird auch in der Theorie der Differentialgleichungen verwendet: gegebene Funktionen (angenommen, sie sind mal differenzierbar), ist die Wronskianer definiert als

Sie ist ungleich Null (für einige ) in einem bestimmten Intervall, wenn und nur wenn die gegebenen Funktionen und alle ihre Ableitungen bis zur Ordnung linear unabhängig sind. Wenn gezeigt werden kann, dass die Wronskianer überall in einem Intervall Null ist, dann bedeutet dies im Fall von analytischen Funktionen, dass die gegebenen Funktionen linear abhängig sind. Siehe die Wronskianer und lineare Unabhängigkeit. Eine weitere Anwendung der Determinante ist die Resultante, die ein Kriterium dafür liefert, wann zwei Polynome eine gemeinsame Wurzel haben. ⓘ

Orientierung einer Basis

Man kann sich die Determinante so vorstellen, dass sie jeder Folge von n Vektoren in Rn eine Zahl zuordnet, indem sie die quadratische Matrix verwendet, deren Spalten die gegebenen Vektoren sind. So stellt beispielsweise eine orthogonale Matrix mit Einträgen in Rn eine orthonormale Basis im euklidischen Raum dar. Die Determinante einer solchen Matrix bestimmt, ob die Orientierung der Basis mit der Orientierung der Standardbasis übereinstimmt oder ihr entgegengesetzt ist. Ist die Determinante +1, hat die Basis die gleiche Orientierung. Ist sie -1, so hat die Basis die entgegengesetzte Ausrichtung. ⓘ

Allgemeiner ausgedrückt: Wenn die Determinante von A positiv ist, stellt A eine orientierungserhaltende lineare Transformation dar (wenn A eine orthogonale 2 × 2- oder 3 × 3-Matrix ist, handelt es sich um eine Drehung), während A, wenn sie negativ ist, die Orientierung der Basis ändert. ⓘ

Volumen und Jacobi-Determinante

Wie bereits erwähnt, ist der Absolutwert der Determinante von reellen Vektoren gleich dem Volumen des von diesen Vektoren aufgespannten Parallelepipeds. Daraus folgt, dass, wenn die lineare Abbildung ist, die durch Multiplikation mit einer Matrix , und eine beliebige messbare Teilmenge ist, dann ist das Volumen von ist gegeben durch mal dem Volumen von . Allgemeiner ausgedrückt: Wenn die lineare Abbildung dargestellt wird durch die -Matrix dargestellt wird, dann ist das -dimensionale Volumen von gegeben durch:

Durch die Berechnung des Volumens des Tetraeders, das durch vier Punkte begrenzt wird, können sie zur Identifizierung schiefer Linien verwendet werden. Das Volumen eines beliebigen Tetraeders mit seinen Eckpunkten , oder jede andere Kombination von Paaren von Scheitelpunkten, die einen spannenden Baum über die Scheitelpunkte bilden. ⓘ

Für eine allgemeine differenzierbare Funktion lässt sich vieles von dem oben Gesagten übertragen, wenn man die Jacobimatrix von f betrachtet.

ist die Jacobimatrix die n × n-Matrix, deren Einträge durch die partiellen Ableitungen gegeben sind

Ihre Determinante, die Jacobische Determinante, erscheint in der höherdimensionalen Version der Integration durch Substitution: Für geeignete Funktionen f und eine offene Teilmenge U von Rn (das Gebiet von f) ist das Integral über f(U) einer anderen Funktion φ : Rn → Rm gegeben durch

Der Jacobi kommt auch im Satz von der umgekehrten Funktion vor. ⓘ

Im Bereich der Kartographie kann die Determinante verwendet werden, um die Expansionsrate einer Karte in der Nähe der Pole zu messen. ⓘ

Abstrakte algebraische Aspekte

Determinante eines Endomorphismus

Die oben genannten Identitäten bezüglich der Determinante von Produkten und Inversen von Matrizen implizieren, dass ähnliche Matrizen die gleiche Determinante haben: Zwei Matrizen A und B sind ähnlich, wenn es eine invertierbare Matrix X gibt, so dass A = X-1BX ist. Die wiederholte Anwendung der obigen Identitäten ergibt in der Tat ⓘ

Die Determinante wird daher auch als Ähnlichkeitsinvariante bezeichnet. Die Determinante einer linearen Transformation

für einen endlichdimensionalen Vektorraum V ist definiert als die Determinante der Matrix, die sie beschreibt, in Bezug auf eine beliebige Wahl der Basis in V. Durch die Ähnlichkeitsinvarianz ist diese Determinante unabhängig von der Wahl der Basis für V und hängt daher nur vom Endomorphismus T ab. ⓘ

Falls und ähnlich sind, das heißt, falls eine invertierbare Matrix existiert, sodass , dann stimmen ihre Determinanten überein, denn ⓘ

Quadratische Matrizen über kommutativen Ringen

Die obige Definition der Determinante unter Verwendung der Leibniz-Regel gilt allgemeiner, wenn die Einträge der Matrix Elemente eines kommutativen Rings sind sind, wie z.B. die ganzen Zahlen sind, im Gegensatz zum Feld der reellen oder komplexen Zahlen. Darüber hinaus gilt die Charakterisierung der Determinante als die einzige alternierende multilineare Abbildung, die folgende Bedingungen erfüllt erfüllt, immer noch gültig, ebenso wie alle Eigenschaften, die sich aus dieser Charakterisierung ergeben. ⓘ

Eine Matrix ist invertierbar (in dem Sinne, dass es eine inverse Matrix gibt, deren Einträge in ), wenn und nur wenn ihre Determinante ein invertierbares Element in . Für bedeutet dies, dass die Determinante +1 oder -1 ist. Eine solche Matrix wird unimodular genannt. ⓘ

Da die Determinante multiplikativ ist, definiert sie einen Gruppenhomomorphismus

zwischen der allgemeinen linearen Gruppe (der Gruppe der invertierbaren -Matrizen mit Einträgen in ) und der multiplikativen Gruppe der Einheiten in . Da sie die Multiplikation in beiden Gruppen respektiert, ist diese Abbildung ein Gruppenhomomorphismus. ⓘ

Gegeben ein Ringhomomorphismus gibt es eine Abbildung die durch Ersetzen aller Einträge in durch ihre Bilder unter . Die Determinante respektiert diese Abbildungen, d. h. die Identität

gilt. Mit anderen Worten: Das dargestellte Kommutativdiagramm ist kommutativ. ⓘ

Zum Beispiel ist die Determinante der komplex Konjugierten einer komplexen Matrix (die auch die Determinante ihrer konjugierten Transponierten ist) die komplex Konjugierte ihrer Determinante, und für ganzzahlige Matrizen: die Reduktion modulo der Determinante einer solchen Matrix ist gleich der Determinante der Matrix, die modulo (letztere Determinante wird durch modulare Arithmetik berechnet). In der Sprache der Kategorientheorie ist die Determinante eine natürliche Transformation zwischen den beiden Funktoren und . Um eine weitere Abstraktionsebene hinzuzufügen, kann man sagen, dass die Determinante ein Morphismus algebraischer Gruppen ist, von der allgemeinen linearen Gruppe zur multiplikativen Gruppe,

Äußere Algebra

Eine Abbildung vom Raum der quadratischen Matrizen in den zugrunde liegenden Körper bildet jede Matrix auf ihre Determinante ab, wenn sie folgende drei Eigenschaften (Axiome nach Karl Weierstraß) erfüllt, wobei eine quadratische Matrix spaltenweise als geschrieben wird:

- Sie ist multilinear, d. h. linear in jeder Spalte:

- Für alle gilt:

- Für alle und alle gilt:

- Sie ist alternierend, d. h., wenn in zwei Spalten das gleiche Argument steht, ist die Determinante gleich 0:

- Für alle und alle gilt:

- Hieraus folgt, dass sich das Vorzeichen ändert, wenn man zwei Spalten vertauscht:

- Für alle und alle gilt:

- Oft wird diese Folgerung zur Definition von alternierend verwendet. Im Allgemeinen ist diese jedoch nicht zur obigen äquivalent. Wird alternierend nämlich auf die zweite Weise definiert, gibt es keine eindeutige Determinantenform, wenn der Körper, über dem der Vektorraum gebildet wird, ein von 0 verschiedenes Element mit besitzt (Charakteristik 2).

- Sie ist normiert, d. h., die Einheitsmatrix hat die Determinante 1:

Es lässt sich beweisen (und Karl Weierstraß hat dies 1864 oder sogar früher getan), dass es eine und nur eine solche normierte alternierende Multilinearform auf der Algebra der -Matrizen über dem zugrundeliegenden Körper gibt – nämlich diese Determinantenfunktion (Weierstraßsche Determinantenkennzeichnung). Auch die schon erwähnte geometrische Interpretation (Volumeneigenschaft und Orientierung) folgt daraus. ⓘ

Die Determinante einer linearen Transformation eines -dimensionalen Vektorraums oder, allgemeiner, eines freien Moduls vom (endlichen) Rang über einem kommutativen Ring kann auf koordinatenfreie Weise formuliert werden, indem man die -ten äußeren Potenz von . Die Karte induziert eine lineare Abbildung

Diese Definition stimmt mit der konkreteren, koordinatenabhängigen Definition überein. Dies kann mit Hilfe der Eindeutigkeit einer multilinearen alternierenden Form auf -Tupel von Vektoren in . Aus diesem Grund ist die höchste von Null verschiedene äußere Potenz (im Gegensatz zur Determinante, die einem Endomorphismus zugeordnet ist) manchmal auch als Determinante von bezeichnet und ähnlich für komplexere Objekte wie Vektorbündel oder Kettenkomplexe von Vektorräumen. Die Minoren einer Matrix können auch in diesem Rahmen betrachtet werden, indem man niedrigere alternierende Formen betrachtet mit . ⓘ

Verallgemeinerungen und verwandte Begriffe

Determinanten, wie sie oben behandelt wurden, lassen mehrere Varianten zu: Die Permanenz einer Matrix ist definiert als die Determinante, mit der Ausnahme, dass die Faktoren die in der Leibnizschen Regel vorkommen, weggelassen werden. Die Immanante verallgemeinert beide durch die Einführung eines Charakters der symmetrischen Gruppe in die Leibnizsche Regel einführt. ⓘ

Determinanten für endlich-dimensionale Algebren

Für jede assoziative Algebra die als Vektorraum über einem Feld endlich-dimensional ist , gibt es eine Determinantenabbildung ⓘ

Diese Definition geht davon aus, dass das charakteristische Polynom unabhängig von der Determinante ist, und definiert die Determinante als den Term niedrigster Ordnung dieses Polynoms. Diese allgemeine Definition liefert die Determinante für die Matrixalgebra Sie umfasst aber auch mehrere andere Fälle, darunter die Determinante eines Quaternions,

- ,

die Norm einer Felderweiterung sowie die Pfaffsche Norm einer schiefsymmetrischen Matrix und die reduzierte Norm einer zentralen einfachen Algebra sind ebenfalls Spezialfälle dieser Konstruktion. ⓘ

Unendliche Matrizen

Für Matrizen mit einer unendlichen Anzahl von Zeilen und Spalten lassen sich die obigen Definitionen der Determinante nicht direkt übernehmen. In der Leibniz-Formel müsste zum Beispiel eine unendliche Summe (deren Terme alle unendliche Produkte sind) berechnet werden. Die Funktionalanalysis bietet verschiedene Erweiterungen der Determinante für solche unendlich-dimensionalen Situationen, die jedoch nur für bestimmte Arten von Operatoren funktionieren. ⓘ

Die Fredholm-Determinante definiert die Determinante für Operatoren, die als Spurklassenoperatoren bekannt sind, durch eine geeignete Verallgemeinerung der Formel

Ein weiterer unendlich-dimensionaler Begriff der Determinante ist die funktionale Determinante. ⓘ

Operatoren in von-Neumann-Algebren

Für Operatoren in einem endlichen Faktor kann man eine positive reellwertige Determinante definieren, die Fuglede-Kadison-Determinante, die die kanonische Spur verwendet. In der Tat gibt es für jeden Trace-Zustand auf einer von-Neumann-Algebra einen Begriff der Fuglede-Kadison-Determinante. ⓘ

Verwandte Begriffe für nicht-kommutative Ringe

Für Matrizen über nicht-kommutativen Ringen sind Multilinearität und alternierende Eigenschaften für n ≥ 2 unvereinbar, so dass es keine gute Definition der Determinante in diesem Bereich gibt. ⓘ

Für quadratische Matrizen mit Einträgen in einem nicht-kommutativen Ring gibt es verschiedene Schwierigkeiten bei der Definition von Determinanten analog zu denen für kommutative Ringe. Der Leibniz-Formel kann eine Bedeutung gegeben werden, sofern die Reihenfolge für das Produkt angegeben wird, und ähnlich verhält es sich mit anderen Definitionen der Determinante, aber die Nicht-Kommutativität führt dann zum Verlust vieler grundlegender Eigenschaften der Determinante, wie der multiplikativen Eigenschaft oder der Tatsache, dass die Determinante bei Transposition der Matrix unverändert bleibt. Für nicht-kommutative Ringe gibt es keinen vernünftigen Begriff einer Multilinearform (das Vorhandensein einer bilinearen Form ungleich Null mit einem regulären Element von R als Wert auf einem Paar von Argumenten impliziert, dass R kommutativ ist). Dennoch wurden verschiedene Begriffe der nicht-kommutativen Determinante formuliert, die einige der Eigenschaften von Determinanten bewahren, insbesondere Quasideterminanten und die Dieudonné-Determinante. Für einige Klassen von Matrizen mit nicht-kommutativen Elementen kann man die Determinante definieren und Theoreme der linearen Algebra beweisen, die ihren kommutativen Entsprechungen sehr ähnlich sind. Beispiele sind die q-Determinante für Quantengruppen, die Capelli-Determinante für Capelli-Matrizen und die Berezinsche Determinante für Supermatrizen (d. h. Matrizen, deren Einträge Elemente von -gradierten Ringen sind). Manin-Matrizen bilden die Klasse, die den Matrizen mit kommutativen Elementen am nächsten kommt. ⓘ

Berechnung

Determinanten werden hauptsächlich als theoretisches Werkzeug verwendet. In der numerischen linearen Algebra werden sie nur selten explizit berechnet, da die Determinante für Anwendungen wie die Überprüfung der Invertierbarkeit und die Ermittlung von Eigenwerten weitgehend durch andere Techniken ersetzt wurde. In der numerischen Geometrie werden jedoch häufig Berechnungen im Zusammenhang mit Determinanten durchgeführt. ⓘ

Während die Determinante direkt mit der Leibniz-Regel berechnet werden kann, ist dieser Ansatz für große Matrizen extrem ineffizient, da diese Formel die Berechnung von ( Faktorielle) Produkte für eine -Matrix erfordert. Die Anzahl der erforderlichen Operationen wächst daher sehr schnell: Sie liegt in der Größenordnung . Die Laplace-Erweiterung ist ähnlich ineffizient. Daher wurden aufwändigere Verfahren zur Berechnung von Determinanten entwickelt. ⓘ

Zersetzungsmethoden

Einige Methoden berechnen indem die Matrix als Produkt von Matrizen geschrieben wird, deren Determinanten leichter berechnet werden können. Solche Techniken werden als Zerlegungsmethoden bezeichnet. Beispiele sind die LU-Zerlegung, die QR-Zerlegung oder die Cholesky-Zerlegung (für positiv definite Matrizen). Diese Methoden sind von der Ordnung was eine erhebliche Verbesserung gegenüber . ⓘ

Zum Beispiel drückt die LU-Zerlegung als ein Produkt

einer Permutationsmatrix (die genau eine einzige in jeder Spalte und ansonsten Nullen hat), einer unteren Dreiecksmatrix und einer oberen Dreiecksmatrix . Die Determinanten der beiden Dreiecksmatrizen und lassen sich schnell berechnen, da sie die Produkte der jeweiligen Diagonaleinträge sind. Die Determinante von ist einfach das Vorzeichen der entsprechenden Permutation (das ist für eine gerade Anzahl von Permutationen und ist für eine ungerade Anzahl von Permutationen). Sobald eine solche LU-Zerlegung bekannt ist für bekannt ist, lässt sich ihre Determinante leicht wie folgt berechnen ⓘ

Weitere Methoden

Die Ordnung die durch Zerlegungsmethoden erreicht wird, wurde durch verschiedene Methoden verbessert. Wenn zwei Matrizen der Ordnung in der Zeit multipliziert werden können , wobei für einige multipliziert werden, dann gibt es einen Algorithmus, der die Determinante in der Zeit . Das bedeutet zum Beispiel, dass ein Algorithmus existiert, der auf dem Coppersmith-Winograd-Algorithmus basiert. Dieser Exponent wurde 2016 weiter auf 2,373 gesenkt. ⓘ

Neben der Komplexität des Algorithmus können weitere Kriterien zum Vergleich von Algorithmen herangezogen werden. Insbesondere für Anwendungen, die Matrizen über Ringe betreffen, gibt es Algorithmen, die die Determinante ohne Divisionen berechnen. (Im Gegensatz dazu erfordert die Gauß-Elimination Divisionen.) Ein solcher Algorithmus, dessen Komplexität basiert auf der folgenden Idee: Man ersetzt Permutationen (wie in der Leibniz-Regel) durch so genannte geschlossene geordnete Spaziergänge, in denen mehrere Elemente wiederholt werden können. Die sich daraus ergebende Summe hat mehr Terme als bei der Leibniz-Regel, aber dabei können mehrere dieser Produkte wiederverwendet werden, was das Verfahren effizienter macht als das naive Rechnen mit der Leibniz-Regel. Algorithmen können auch nach ihrer Bitkomplexität bewertet werden, d. h. danach, wie viele Bits an Genauigkeit benötigt werden, um die bei der Berechnung auftretenden Zwischenwerte zu speichern. Die Gaußsche Eliminationsmethode (oder LU-Zerlegung) hat zum Beispiel die Ordnung , aber die Bitlänge der Zwischenwerte kann exponentiell lang werden. Im Vergleich dazu hat der Bareiss-Algorithmus, eine Methode der exakten Division (d. h. er verwendet zwar Divisionen, aber nur in Fällen, in denen diese Divisionen ohne Rest durchgeführt werden können), dieselbe Ordnung, aber die Bitkomplexität entspricht ungefähr der Bitgröße der ursprünglichen Einträge in der Matrix mal . ⓘ

Wenn die Determinante von A und die Inverse von A bereits berechnet wurden, ermöglicht das Determinantenlemmas der Matrix die schnelle Berechnung der Determinante von A + uvT, wobei u und v Spaltenvektoren sind. ⓘ

Charles Dodgson (d. h. Lewis Carroll, bekannt durch Alices Abenteuer im Wunderland) erfand eine Methode zur Berechnung von Determinanten, die Dodgson-Kondensation. Leider funktioniert diese interessante Methode nicht immer in ihrer ursprünglichen Form. ⓘ

Permanente

Die Permanente ist ein „vorzeichenloses“ Analogon zur Determinante, wird allerdings viel seltener verwendet. ⓘ

Spezielle Determinanten

- Wronski-Determinante

- Pfaffsche Determinante

- Vandermonde-Determinante

- Gramsche Determinante

- Funktionaldeterminante (auch Jacobi-Determinante genannt)

- Determinante (Knotentheorie) ⓘ

![{\displaystyle {\begin{aligned}|A|={\begin{vmatrix}a&b&c\\d&e&f\\g&h&i\end{vmatrix}}&=a\,{\begin{vmatrix}e&f\\h&i\end{vmatrix}}-b\,{\begin{vmatrix}d&f\\g&i\end{vmatrix}}+c\,{\begin{vmatrix}d&e\\g&h\end{vmatrix}}\\[3pt]&=aei+bfg+cdh-ceg-bdi-afh.\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a891ca1b518ba39ff21a458c74f9cc74bcefb18c)

![{\displaystyle A=\left[{\begin{array}{c|c|c|c}\mathbf {a} _{1}&\mathbf {a} _{2}&\cdots &\mathbf {a} _{n}\end{array}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b1d60337c4cde7b2d5fc3e0365bc8ec5e699ea1a)

![{\displaystyle \det \left(A^{-1}\right)={\frac {1}{\det(A)}}=[\det(A)]^{-1}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f4f6798a0a88679c1b82126428cf67aae28244fc)

![{\displaystyle {\sqrt[{n}]{\det {\!(A+B)}}}\leq {\sqrt[{n}]{\det {\!(A)}}}+{\sqrt[{n}]{\det {\!(B)}}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a51444f1f8d1f3d04f230a3ff805e4e34cca6e78)