Chi-Quadrat-Verteilung

Die Chi-Quadrat-Verteilung bzw. -Verteilung (ältere Bezeichnung: Helmert-Pearson-Verteilung, nach Friedrich Robert Helmert und Karl Pearson) ist eine stetige Wahrscheinlichkeitsverteilung über der Menge der nichtnegativen reellen Zahlen. Üblicherweise ist mit „Chi-Quadrat-Verteilung“ die zentrale Chi-Quadrat-Verteilung gemeint. Die Chi-Quadrat-Verteilung hat einen einzigen Parameter, nämlich die Anzahl der Freiheitsgrade . ⓘ

Sie ist eine der Verteilungen, die aus der Normalverteilung abgeleitet werden kann: Hat man Zufallsvariablen , die unabhängig und standardnormalverteilt sind, so ist die Chi-Quadrat-Verteilung mit Freiheitsgraden definiert als die Verteilung der Summe der quadrierten Zufallsvariablen . Solche Summen quadrierter Zufallsvariablen treten bei Schätzfunktionen wie der Stichprobenvarianz zur Schätzung der empirischen Varianz auf. Die Chi-Quadrat-Verteilung ermöglicht damit unter anderem ein Urteil über die Kompatibilität eines vermuteten funktionalen Zusammenhangs (Abhängigkeit von der Zeit, Temperatur, Druck etc.) mit empirisch ermittelten Messpunkten. Kann z. B. eine Gerade die Daten erklären, oder braucht man doch eine Parabel oder vielleicht einen Logarithmus? Man wählt verschiedene Modelle aus, und dasjenige mit der besten Anpassungsgüte, dem kleinsten Chi-Quadrat-Wert, bietet die beste Erklärung der Daten. So stellt die Chi-Quadrat-Verteilung durch die Quantifizierung der zufälligen Schwankungen die Auswahl verschiedener Erklärungsmodelle auf eine numerische Basis. Außerdem erlaubt sie, wenn man die empirische Varianz bestimmt hat, die Schätzung des Vertrauensintervalls, das den (unbekannten) Wert der Varianz der Grundgesamtheit mit einer gewissen Wahrscheinlichkeit einschließt. Diese und weitere Anwendungen sind weiter unten und im Artikel Chi-Quadrat-Test beschrieben. ⓘ

Die Chi-Quadrat-Verteilung wurde 1876 eingeführt von Friedrich Robert Helmert, die Bezeichnung stammt von Karl Pearson (1900). ⓘ

|

Wahrscheinlichkeitsdichtefunktion  | |||

|

Kumulative Verteilungsfunktion  | |||

| Schreibweise | oder | ||

|---|---|---|---|

| Parameter | (bekannt als "Freiheitsgrade") | ||

| Unterstützung | wenn , sonst | ||

| CDF | |||

| Mittelwert | |||

| Median | |||

| Modus | |||

| Varianz | |||

| Schiefe | |||

| Bsp. Kurtosis | |||

| Entropie | |||

| MGF | |||

| CF | |||

| PGF | |||

Definitionen

Wenn Z1, ..., Zk unabhängige, standardnormale Zufallsvariablen sind, dann ist die Summe ihrer Quadrate,

gemäß der Chi-Quadrat-Verteilung mit k Freiheitsgraden verteilt. Dies wird üblicherweise wie folgt bezeichnet

Die Chi-Quadrat-Verteilung hat einen Parameter: eine positive ganze Zahl k, die die Anzahl der Freiheitsgrade angibt (die Anzahl der zu summierenden Zufallsvariablen, Zi s). ⓘ

Einführung

Die Chi-Quadrat-Verteilung wird in erster Linie für Hypothesentests und in geringerem Maße für Konfidenzintervalle für die Varianz der Bevölkerung verwendet, wenn die zugrunde liegende Verteilung normal ist. Im Gegensatz zu bekannteren Verteilungen wie der Normalverteilung und der Exponentialverteilung wird die Chi-Quadrat-Verteilung nicht so häufig für die direkte Modellierung von Naturphänomenen verwendet. Sie kommt unter anderem in den folgenden Hypothesentests zum Einsatz:

- Chi-Quadrat-Test der Unabhängigkeit in Kontingenztabellen

- Chi-Quadrat-Test der Anpassungsgüte von beobachteten Daten an hypothetische Verteilungen

- Likelihood-Ratio-Test für verschachtelte Modelle

- Log-rank-Test in der Überlebensanalyse

- Cochran-Mantel-Haenszel-Test für geschichtete Kontingenztabellen ⓘ

Sie ist auch Bestandteil der Definition der t-Verteilung und der F-Verteilung, die in t-Tests, Varianzanalysen und Regressionsanalysen verwendet werden. ⓘ

Der Hauptgrund für die häufige Verwendung der Chi-Quadrat-Verteilung bei Hypothesentests ist ihre Beziehung zur Normalverteilung. Viele Hypothesentests verwenden eine Teststatistik, z. B. die t-Statistik in einem t-Test. Bei diesen Hypothesentests nähert sich die Stichprobenverteilung der Teststatistik mit zunehmendem Stichprobenumfang n der Normalverteilung an (zentraler Grenzwertsatz). Da die Teststatistik (z. B. t) asymptotisch normalverteilt ist, kann die für den Hypothesentest verwendete Verteilung durch eine Normalverteilung angenähert werden, sofern der Stichprobenumfang ausreichend groß ist. Die Prüfung von Hypothesen anhand einer Normalverteilung ist gut bekannt und relativ einfach. Die einfachste Chi-Quadrat-Verteilung ist das Quadrat einer Standard-Normalverteilung. Wo also eine Normalverteilung für einen Hypothesentest verwendet werden könnte, könnte auch eine Chi-Quadrat-Verteilung verwendet werden. ⓘ

Angenommen, dass eine Zufallsvariable ist, die aus der Standardnormalverteilung entnommen wird, wobei der Mittelwert und die Varianz ist : . Betrachten wir nun die Zufallsvariable . Die Verteilung der Zufallsvariablen ist ein Beispiel für eine Chi-Quadrat-Verteilung: Der Index 1 zeigt an, dass diese spezielle chi-Quadrat-Verteilung aus nur einer Standardnormalverteilung konstruiert wurde. Eine chi-Quadrat-Verteilung, die durch Quadrieren einer einzigen Standardnormalverteilung konstruiert wurde, hat 1 Freiheitsgrad. Mit zunehmender Stichprobengröße für einen Hypothesentest nähert sich die Verteilung der Teststatistik also einer Normalverteilung an. Genauso wie Extremwerte der Normalverteilung eine geringe Wahrscheinlichkeit haben (und kleine p-Werte ergeben), haben Extremwerte der Chi-Quadrat-Verteilung eine geringe Wahrscheinlichkeit. ⓘ

Ein weiterer Grund dafür, dass die Chi-Quadrat-Verteilung weit verbreitet ist, ist, dass sie als große Stichprobenverteilung verallgemeinerter Likelihood-Ratio-Tests (LRT) auftaucht. LRTs haben mehrere wünschenswerte Eigenschaften; insbesondere bieten einfache LRTs in der Regel die höchste Macht, die Nullhypothese zurückzuweisen (Neyman-Pearson-Lemma), und dies führt auch zu Optimalitätseigenschaften von verallgemeinerten LRTs. Die Normal- und Chi-Quadrat-Approximationen sind jedoch nur asymptotisch gültig. Aus diesem Grund ist es bei einem kleinen Stichprobenumfang vorzuziehen, die t-Verteilung anstelle der Normal- oder Chi-Quadrat-Approximation zu verwenden. Auch bei der Analyse von Kontingenztabellen ist die Chi-Quadrat-Approximation bei einem kleinen Stichprobenumfang unzureichend, und es ist vorzuziehen, den exakten Test von Fisher zu verwenden. Ramsey zeigt, dass der exakte Binomialtest immer leistungsfähiger ist als die normale Annäherung. ⓘ

Lancaster zeigt die Zusammenhänge zwischen der Binomial-, Normal- und Chi-Quadrat-Verteilung wie folgt auf. De Moivre und Laplace stellten fest, dass eine Binomialverteilung durch eine Normalverteilung angenähert werden kann. Konkret zeigten sie die asymptotische Normalität der Zufallsvariablen ⓘ

wobei die beobachtete Anzahl von Erfolgen in Versuchen ist, wobei die Erfolgswahrscheinlichkeit und . ⓘ

Die Quadrierung beider Seiten der Gleichung ergibt ⓘ

Unter Verwendung von , und kann diese Gleichung wie folgt umgeschrieben werden ⓘ

Der Ausdruck auf der rechten Seite hat die Form, die Karl Pearson zu folgender Form verallgemeinern würde ⓘ

wobei ⓘ

- = Pearsons kumulative Teststatistik, die sich asymptotisch einer Verteilung nähert.

- = die Anzahl der Beobachtungen des Typs .

- = die erwartete (theoretische) Häufigkeit des Typs unter der Nullhypothese, dass der Anteil des Typs in der Grundgesamtheit ist

- = die Anzahl der Zellen in der Tabelle. ⓘ

Im Falle eines Binomialergebnisses (Werfen einer Münze) kann die Binomialverteilung durch eine Normalverteilung angenähert werden (für ausreichend große ). Da das Quadrat einer Standardnormalverteilung die Chi-Quadrat-Verteilung mit einem Freiheitsgrad ist, kann die Wahrscheinlichkeit eines Ergebnisses wie z. B. 1 Kopf bei 10 Versuchen entweder durch direkte Verwendung der Normalverteilung oder durch die Chi-Quadrat-Verteilung für die normalisierte, quadrierte Differenz zwischen beobachtetem und erwartetem Wert angenähert werden. Viele Probleme beinhalten jedoch mehr als die zwei möglichen Ergebnisse einer Binomialverteilung und erfordern stattdessen 3 oder mehr Kategorien, was zu einer Multinomialverteilung führt. So wie de Moivre und Laplace die normale Annäherung an die Binomialverteilung suchten und fanden, suchte und fand Pearson eine entartete multivariate normale Annäherung an die Multinomialverteilung (die Zahlen in jeder Kategorie addieren sich zur Gesamtstichprobengröße, die als fest angesehen wird). Pearson zeigte, dass die Chi-Quadrat-Verteilung aus einer solchen multivariaten Normalannäherung an die Multinomialverteilung hervorgeht, wobei die statistische Abhängigkeit (negative Korrelationen) zwischen den Zahlen der Beobachtungen in den verschiedenen Kategorien sorgfältig berücksichtigt wurde. ⓘ

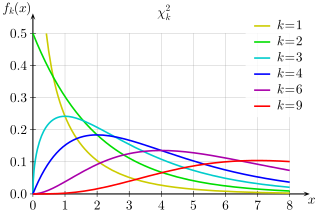

Wahrscheinlichkeitsdichtefunktion

Die Wahrscheinlichkeitsdichtefunktion (pdf) der Chi-Quadrat-Verteilung ist

wobei bezeichnet die Gammafunktion, die geschlossene Werte für ganze Zahlen hat . ⓘ

Für Ableitungen der pdf für die Fälle von einem, zwei und Freiheitsgraden, siehe Beweise für die Chi-Quadrat-Verteilung. ⓘ

Kumulative Verteilungsfunktion

Ihre kumulative Verteilungsfunktion ist:

wobei ist die untere unvollständige Gammafunktion und ist die regularisierte Gammafunktion. ⓘ

In einem speziellen Fall von = 2 hat diese Funktion die einfache Form:

die sich leicht durch Integration ableiten lässt direkt ableiten lässt. Die ganzzahlige Rekursion der Gammafunktion macht es einfach, die Funktion für andere kleine, sogar . ⓘ

Tabellen mit der kumulativen Chi-Quadrat-Verteilungsfunktion sind weit verbreitet und die Funktion ist in vielen Tabellenkalkulationen und allen Statistikpaketen enthalten. ⓘ

Lässt man kann man Chernoff-Schranken für die unteren und oberen Schwänze der CDF erhalten. Für die Fälle, in denen (zu denen alle Fälle gehören, in denen diese CDF weniger als die Hälfte beträgt):

Die Schwanzschranke für die Fälle, in denen ist in ähnlicher Weise

Für eine andere Annäherung an die CDF, die nach dem Würfel eines Gauß modelliert ist, siehe unter Nichtzentrale Chi-Quadrat-Verteilung. ⓘ

Eigenschaften

Cochran-Theorem

Wenn Z1, ..., Zk unabhängige, identisch verteilte (i.i.d.), standardnormale Zufallsvariablen sind, dann

wobei

Additivität

Aus der Definition der Chi-Quadrat-Verteilung folgt, dass die Summe der unabhängigen Chi-Quadrat-Variablen ebenfalls chi-Quadrat-verteilt ist. Genauer gesagt, wenn unabhängige chi-Quadrat-Variablen sind mit , Freiheitsgraden, dann ist chi-Quadrat-verteilt mit Freiheitsgraden. ⓘ

Stichprobenmittelwert

Der Stichprobenmittelwert von i.i.d. chi-Quadrat-Variablen des Grades ist verteilt gemäß einer Gamma-Verteilung mit Form und Skala Parametern:

Asymptotisch konvergiert eine Gamma-Verteilung für einen Skalenparameter gegen unendlich geht, konvergiert eine Gamma-Verteilung gegen eine Normalverteilung mit Erwartungswert und Varianz konvergiert der Stichprobenmittelwert gegen:

Man beachte, dass man das gleiche Ergebnis erhält, wenn man sich stattdessen auf den zentralen Grenzwertsatz beruft und feststellt, dass für jede Chi-Quadrat-Variable vom Grad der Erwartungswert und ihre Varianz (und damit die Varianz des Stichprobenmittelwerts ist. ). ⓘ

Entropie

Die differentielle Entropie ist gegeben durch

wobei ψ(x) die Digamma-Funktion ist. ⓘ

Die Chi-Quadrat-Verteilung ist die Wahrscheinlichkeitsverteilung mit maximaler Entropie für eine Zufallsvariable für die und fest sind. Da die Chi-Quadrat-Verteilung zur Familie der Gamma-Verteilungen gehört, kann sie durch Einsetzen geeigneter Werte in den Erwartungswert des logarithmischen Moments von Gamma abgeleitet werden. Für die Ableitung aus grundlegenderen Prinzipien siehe die Ableitung der momentgenerierenden Funktion der hinreichenden Statistik. ⓘ

Nicht-zentrale Momente

Die Momente um Null einer Chi-Quadrat-Verteilung mit Freiheitsgraden sind gegeben durch

Kumulanten

Die Kumulanten lassen sich leicht durch eine (formale) Potenzreihenentwicklung des Logarithmus der charakteristischen Funktion ermitteln:

Concentration

Die Chi-Quadrat-Verteilung weist eine starke Konzentration um ihren Mittelwert auf. Die Standardschranken von Laurent-Massart sind:

Asymptotische Eigenschaften

Da die Chi-Quadrat-Verteilung die Summe von unabhängigen Zufallsvariablen mit endlichem Mittelwert und endlicher Anzahl von Zufallsvariablen ist, gilt der zentrale Grenzwertsatz. unabhängigen Zufallsvariablen mit endlichem Mittelwert und endlicher Varianz ist, konvergiert sie für große . Für viele praktische Zwecke, für ist die Verteilung so nahe an einer Normalverteilung, dass der Unterschied ignoriert werden kann. Genauer gesagt, wenn dann konvergiert bei gegen unendlich tendiert, wird die Verteilung von zu einer Standard-Normalverteilung tendiert. Die Konvergenz ist jedoch langsam, da die Schiefe und die übermäßige Kurtosis ist . ⓘ

Die Stichprobenverteilung von konvergiert viel schneller zur Normalverteilung als die Stichprobenverteilung von da der Logarithmus einen Großteil der Asymmetrie beseitigt. Andere Funktionen der Chi-Quadrat-Verteilung konvergieren schneller gegen eine Normalverteilung. Einige Beispiele sind:

- Wenn dann ist annähernd normalverteilt ist mit Mittelwert und Einheitsvarianz (1922, von R. A. Fisher, siehe (18.23), S. 426 von Johnson.

- Wenn dann ist annähernd normalverteilt ist mit Mittelwert und Varianz Dies ist bekannt als die Wilson-Hilferty-Transformation, siehe (18.24), S. 426 von Johnson.

- Diese normalisierende Transformation führt direkt zu der häufig verwendeten Median-Näherung durch Rücktransformation vom Mittelwert, der auch der Median ist, der Normalverteilung. ⓘ

Momenterzeugende Funktion

Die momenterzeugende Funktion für hat die Form

- . ⓘ

Nichtzentrale Chi-Quadrat-Verteilung

Verteilungsfunktion

Die Verteilungsfunktion der nichtzentralen Chi-Quadrat-Verteilung kann mit Hilfe der Marcum-Q-Funktion ausgedrückt werden. ⓘ

Verwandte Verteilungen

- Wie , (Normalverteilung)

- (nichtzentrale Chi-Quadrat-Verteilung mit Nicht-Zentralitätsparameter )

- Wenn dann ist hat die Chi-Quadrat-Verteilung

- Als Spezialfall, wenn dann ist hat die Chi-Quadrat-Verteilung

- (Die quadrierte Norm von k standardnormalverteilten Variablen ist eine Chi-Quadrat-Verteilung mit k Freiheitsgraden)

- Wenn und , dann . (Gamma-Verteilung)

- Wenn dann ist (chi-Verteilung)

- Wenn , dann eine Exponentialverteilung ist. (Siehe Gamma-Verteilung für mehr.)

- Wenn , dann ist eine Erlang-Verteilung.

- Wenn , dann

- Wenn (Rayleigh-Verteilung) dann

- Wenn (Maxwell-Verteilung) dann

- Wenn dann ist (Inverse Chi-Quadrat-Verteilung)

- Die Chi-Quadrat-Verteilung ist ein Spezialfall der Pearson-Verteilung vom Typ III

- Wenn und unabhängig sind, dann (Beta-Verteilung)

- Wenn (Gleichverteilung) dann

- Wenn dann ist

- Wenn folgt der verallgemeinerten Normalverteilung (Version 1) mit den Parametern dann ist

- die Chi-Quadrat-Verteilung ist eine Transformation der Pareto-Verteilung

- Die Student's t-Verteilung ist eine Transformation der chi-Quadrat-Verteilung

- Die Student's t-Verteilung kann aus der Chi-Quadrat-Verteilung und der Normalverteilung abgeleitet werden.

- Die nicht zentrale Beta-Verteilung kann als Transformation der Chi-Quadrat-Verteilung und der nicht zentralen Chi-Quadrat-Verteilung erhalten werden.

- Die nichtzentrale t-Verteilung lässt sich aus der Normalverteilung und der Chi-Quadrat-Verteilung ableiten. ⓘ

Eine chi-Quadrat-Variable mit Freiheitsgraden ist definiert als die Summe der Quadrate von unabhängigen Standard-Normal-Zufallsvariablen definiert. ⓘ

Wenn ist eine -dimensionaler Gaußscher Zufallsvektor mit Mittelwertvektor und Rang Kovarianzmatrix , dann chi-Quadrat-verteilt mit Freiheitsgraden. ⓘ

Die Summe der Quadrate statistisch unabhängiger Gauß-Variablen mit Einheitsvarianz, die nicht den Mittelwert Null haben, ergibt eine Verallgemeinerung der Chi-Quadrat-Verteilung, die so genannte nichtzentrale Chi-Quadrat-Verteilung. ⓘ

Wenn ist ein Vektor von i.i.d.-Standardnormalzufallsvariablen und ist eine symmetrische, idempotente Matrix mit Rang ist, dann ist die quadratische Form chi-Quadrat-verteilt ist mit Freiheitsgraden. ⓘ

Wenn ist eine positiv-semidefinite Kovarianzmatrix mit streng positiven Diagonaleinträgen, dann ist für und einen zufälligen -Vektor unabhängig von so dass und gilt, dass ⓘ

Die Chi-Quadrat-Verteilung steht auch in natürlicher Beziehung zu anderen Verteilungen, die sich aus der Gauß-Verteilung ergeben. Insbesondere ⓘ

- F-verteilt ist, wenn , wobei und statistisch unabhängig sind.

- Wenn und statistisch unabhängig sind, dann . Wenn und nicht unabhängig sind, dann nicht chi-Quadrat-verteilt. ⓘ

worin die unabhängige gleichmäßig stetig verteilte Zufallsvariablen sind. ⓘ

Verallgemeinerungen

Die Chi-Quadrat-Verteilung ergibt sich als Summe der Quadrate von k unabhängigen Gaußschen Zufallsvariablen mit Mittelwert Null und Einheitsvarianz. Verallgemeinerungen dieser Verteilung können durch Summierung der Quadrate anderer Arten von Gaußschen Zufallsvariablen erhalten werden. Mehrere solcher Verteilungen werden im Folgenden beschrieben. ⓘ

Lineare Kombination

Wenn sind chi-quadratische Zufallsvariablen und dann ist ein geschlossener Ausdruck für die Verteilung von nicht bekannt. Sie kann jedoch mit Hilfe der Eigenschaft der charakteristischen Funktionen von chi-Quadrat-Zufallsvariablen effizient angenähert werden. ⓘ

Chi-Quadrat-Verteilungen

Nichtzentrale chi-Quadrat-Verteilung

Die nichtzentrale Chi-Quadrat-Verteilung ergibt sich aus der Summe der Quadrate unabhängiger Gaußscher Zufallsvariablen mit Einheitsvarianz und Mittelwerten ungleich Null. ⓘ

Verallgemeinerte Chi-Quadrat-Verteilung

Die verallgemeinerte Chi-Quadrat-Verteilung ergibt sich aus der quadratischen Form z′Az, wobei z ein Gauß-Vektor mit dem Mittelwert Null und einer beliebigen Kovarianzmatrix ist und A eine beliebige Matrix darstellt. ⓘ

Gamma-, Exponential- und verwandte Verteilungen

Die Chi-Quadrat-Verteilung ist ein Spezialfall der Gamma-Verteilung, bei dem unter Verwendung der Ratenparametrisierung der Gamma-Verteilung (oder unter Verwendung der Skalenparametrisierung der Gamma-Verteilung) wobei k eine ganze Zahl ist. ⓘ

Da die Exponentialverteilung auch ein Spezialfall der Gammaverteilung ist, gilt auch, dass wenn , dann eine Exponentialverteilung ist. ⓘ

Die Erlang-Verteilung ist ebenfalls ein Spezialfall der Gamma-Verteilung und somit gilt auch, dass wenn mit gerader , dann eine Erlang-Verteilung ist mit dem Formparameter und Skalenparameter . ⓘ

Vorkommen und Anwendungen

Die Chi-Quadrat-Verteilung hat zahlreiche Anwendungen in der Inferenzstatistik, zum Beispiel bei Chi-Quadrat-Tests und bei der Schätzung von Varianzen. Sie geht in das Problem der Schätzung des Mittelwerts einer normalverteilten Grundgesamtheit und in das Problem der Schätzung der Steigung einer Regressionsgeraden über ihre Rolle in der Student's t-Verteilung ein. Bei allen Problemen der Varianzanalyse spielt sie eine Rolle in der F-Verteilung, der Verteilung des Verhältnisses zweier unabhängiger Chi-Quadrat-Zufallsvariablen, jeweils geteilt durch ihre jeweiligen Freiheitsgrade. ⓘ

Nachfolgend sind einige der häufigsten Situationen aufgeführt, in denen die Chi-Quadrat-Verteilung aus einer Gauß-verteilten Stichprobe entsteht. ⓘ

- wenn sind i.i.d. Zufallsvariablen, dann wobei .

- Der folgende Kasten zeigt einige Statistiken, die auf unabhängigen Zufallsvariablen, deren Wahrscheinlichkeitsverteilungen mit der Chi-Quadrat-Verteilung verwandt sind:

| Name | Statistik |

|---|---|

| chi-Quadrat-Verteilung | |

| nicht-zentrale chi-Quadrat-Verteilung | |

| chi-Verteilung | |

| nicht-zentrale chi-Verteilung |

Die Chi-Quadrat-Verteilung ist auch in der Magnetresonanztomographie häufig anzutreffen. ⓘ

Berechnungsmethoden

Tabelle der χ2-Werte vs. p-Werte

Der p-Wert ist die Wahrscheinlichkeit, eine Teststatistik zu beobachten, die bei einer Chi-Quadrat-Verteilung mindestens so extrem ist. Da die kumulative Verteilungsfunktion (CDF) für die entsprechenden Freiheitsgrade (df) die Wahrscheinlichkeit angibt, einen Wert zu erhalten, der weniger extrem als dieser Punkt ist, ergibt das Subtrahieren des CDF-Wertes von 1 den p-Wert. Ein niedriger p-Wert, der unter dem gewählten Signifikanzniveau liegt, weist auf statistische Signifikanz hin, d. h. auf eine ausreichende Evidenz, um die Nullhypothese zu verwerfen. Ein Signifikanzniveau von 0,05 wird häufig als Grenze zwischen signifikanten und nicht-signifikanten Ergebnissen verwendet. ⓘ

Die folgende Tabelle enthält eine Reihe von p-Werten, die mit für die ersten 10 Freiheitsgrade. ⓘ

| Freiheitsgrade (df) | Wert ⓘ | ||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | 0.004 | 0.02 | 0.06 | 0.15 | 0.46 | 1.07 | 1.64 | 2.71 | 3.84 | 6.63 | 10.83 |

| 2 | 0.10 | 0.21 | 0.45 | 0.71 | 1.39 | 2.41 | 3.22 | 4.61 | 5.99 | 9.21 | 13.82 |

| 3 | 0.35 | 0.58 | 1.01 | 1.42 | 2.37 | 3.66 | 4.64 | 6.25 | 7.81 | 11.34 | 16.27 |

| 4 | 0.71 | 1.06 | 1.65 | 2.20 | 3.36 | 4.88 | 5.99 | 7.78 | 9.49 | 13.28 | 18.47 |

| 5 | 1.14 | 1.61 | 2.34 | 3.00 | 4.35 | 6.06 | 7.29 | 9.24 | 11.07 | 15.09 | 20.52 |

| 6 | 1.63 | 2.20 | 3.07 | 3.83 | 5.35 | 7.23 | 8.56 | 10.64 | 12.59 | 16.81 | 22.46 |

| 7 | 2.17 | 2.83 | 3.82 | 4.67 | 6.35 | 8.38 | 9.80 | 12.02 | 14.07 | 18.48 | 24.32 |

| 8 | 2.73 | 3.49 | 4.59 | 5.53 | 7.34 | 9.52 | 11.03 | 13.36 | 15.51 | 20.09 | 26.12 |

| 9 | 3.32 | 4.17 | 5.38 | 6.39 | 8.34 | 10.66 | 12.24 | 14.68 | 16.92 | 21.67 | 27.88 |

| 10 | 3.94 | 4.87 | 6.18 | 7.27 | 9.34 | 11.78 | 13.44 | 15.99 | 18.31 | 23.21 | 29.59 |

| p-Wert (Wahrscheinlichkeit) | 0.95 | 0.90 | 0.80 | 0.70 | 0.50 | 0.30 | 0.20 | 0.10 | 0.05 | 0.01 | 0.001 |

Diese Werte können berechnet werden, indem man die Quantilfunktion (auch "inverse CDF" oder "ICDF" genannt) der Chi-Quadrat-Verteilung auswertet; z. B. ergibt die χ2 ICDF für p = 0,05 und df = 7 den Wert 2,1673 ≈ 2,17 wie in der obigen Tabelle, wobei zu beachten ist, dass 1 - p der p-Wert aus der Tabelle ist. ⓘ

Geschichte

Diese Verteilung wurde erstmals von dem deutschen Statistiker Friedrich Robert Helmert in Arbeiten von 1875-6 beschrieben, in denen er die Stichprobenverteilung der Stichprobenvarianz einer Normalpopulation berechnete. Daher wurde sie im Deutschen traditionell als Helmert'sche ("Helmertian") oder "Helmert-Verteilung" bezeichnet. ⓘ

Unabhängig davon wurde die Verteilung von dem englischen Mathematiker Karl Pearson im Zusammenhang mit der Anpassungsgüte wiederentdeckt, für die er seinen Pearson's Chi-Quadrat-Test entwickelte, der 1900 veröffentlicht wurde, mit berechneten Wertetabellen, die in (Elderton 1902) veröffentlicht und in (Pearson 1914, S. xxxi-xxxiii, 26-28, Tabelle XII) zusammengefasst wurden. Der Name "Chi-Quadrat" leitet sich letztlich von Pearsons Abkürzung für den Exponenten in einer multivariaten Normalverteilung mit dem griechischen Buchstaben Chi ab, der lautet -½χ2 für das, was in moderner Notation als -½xTΣ-1x erscheinen würde (Σ ist die Kovarianzmatrix). Die Idee einer Familie von "Chi-Quadrat-Verteilungen" geht jedoch nicht auf Pearson zurück, sondern ist eine Weiterentwicklung, die in den 1920er Jahren von Fisher eingeführt wurde. ⓘ

Dichte

Die Dichte der -Verteilung mit Freiheitsgraden hat die Form:

Dabei steht für die Gammafunktion. Die Werte von kann man mit ⓘ

- . ⓘ

berechnen. ⓘ

Verteilungsfunktion

Die Verteilungsfunktion kann man mit Hilfe der regularisierten unvollständigen Gammafunktion schreiben:

Wenn eine natürliche Zahl ist, dann kann die Verteilungsfunktion (mehr oder weniger) elementar dargestellt werden:

wobei die Fehlerfunktion bezeichnet. Die Verteilungsfunktion beschreibt die Wahrscheinlichkeit, dass im Intervall liegt. ⓘ

Beispiel

Gegeben sind Messungen einer Größe , die aus einer normalverteilten Grundgesamtheit stammen. Sei der empirische Mittelwert der gemessenen Werte und

die korrigierte Stichprobenvarianz. ⓘ

Dann lässt sich z. B. das Konfidenzintervall für die Varianz der Grundgesamtheit angeben:

Die Grenzen ergeben sich daraus, dass wie verteilt ist. ⓘ

Konkretes Beispiel: Stichprobe mit Werten, Varianz , 95%-Konfidenzintervall: 95% der Werte sollen sich innerhalb des Intervalls befinden. Es wird also davon Ausgegangen, dass je 2,5% der Werte die obere bzw. untere Intervallgrenze überschreiten dürfen. In diesem Fall wird daher durch und durch bestimmt. ⓘ

Bei der Berechnung der Grenzen des Konfidenzintervalls in Programmen wird üblicherweise die Inverse Funktion verwendet (Kehrwert der kumulierten Chi-Quadrat-Verteilung): z. B. in Excel oder Numbers die Funktion CHIINV(p,n-1) :

Die obere Intervallgrenze ergibt sich mit aus:

=CHIINV(0,025; 99) / 99 * s^2 = 1,2971 ⓘ

Die untere Intervallgrenze ergibt sich aus:

=CHIINV(0,975; 99) / 99 * s^2 = 0,7410 ⓘ

Beziehung zu anderen Verteilungen

Beziehung zur F-Verteilung

Seien und unabhängige Chi-Quadrat-verteilte Zufallsvariablen mit und Freiheitsgraden, dann ist der Quotient

F-verteilt mit Zählerfreiheitsgraden und Nennerfreiheitsgraden. ⓘ

Beziehung zur Poisson-Verteilung

Die Verteilungsfunktionen der Poisson-Verteilung und der Chi-Quadrat-Verteilung hängen auf folgende Weise zusammen: Die Wahrscheinlichkeit, oder mehr Ereignisse in einem Intervall zu finden, innerhalb dessen man im Mittel Ereignisse erwartet, gleicht der Wahrscheinlichkeit, dass der Wert von ist. Es gilt nämlich

- , ⓘ

mit und als regularisierte Gammafunktionen. ⓘ

Herleitung der Dichtefunktion

Die Dichte der Zufallsvariable , mit unabhängig und standardnormalverteilt, ergibt sich aus der gemeinsamen Dichte der Zufallsvariablen . Diese gemeinsame Dichte ist das -fache Produkt der Standardnormalverteilungsdichte:

Für die gesuchte Dichte gilt:

mit ⓘ

Im Grenzwert ist die Summe im Argument der Exponentialfunktion gleich . Man kann zeigen, dass man den Integranden als vor das Integral und den Limes ziehen kann. ⓘ

Das verbleibende Integral ⓘ

entspricht dem Volumen der Schale zwischen der Kugel mit Radius und der Kugel mit Radius , ⓘ

wobei das Volumen der n-dimensionalen Kugel mit Radius R angibt. ⓘ

Es folgt: ⓘ

und nach Einsetzen in den Ausdruck für die gesuchte Dichte: . ⓘ

Quantilfunktion

Die Quantilfunktion der Chi-Quadrat-Verteilung ist die Lösung der Gleichung und damit prinzipiell über die Umkehrfunktion zu berechnen. Konkret gilt hier

mit als Inverse der regularisierten unvollständigen Gammafunktion. Dieser Wert ist in der Quantiltabelle unter den Koordinaten und eingetragen. ⓘ

Quantilfunktion für kleinen Stichprobenumfang

Für wenige Werte (1, 2, 4) kann man die Quantilfunktion auch alternativ angeben:

wobei die Fehlerfunktion, den unteren Zweig der Lambertschen W-Funktion bezeichnet und die Eulersche Zahl. ⓘ

Näherung der Quantilfunktion für feste Wahrscheinlichkeiten

Für bestimmte feste Wahrscheinlichkeiten lassen sich die zugehörigen Quantile durch die einfache Funktion des Stichprobenumfangs

mit den Parametern aus der Tabelle annähern, wobei die Signum-Funktion bezeichnet, die einfach das Vorzeichen ihres Arguments darstellt:

| 0,005 | 0,01 | 0,025 | 0,05 | 0,1 | 0,5 | 0,9 | 0,95 | 0,975 | 0,99 | 0,995 ⓘ | |

| −3,643 | −3,298 | −2,787 | −2,34 | −1,83 | 0 | 1,82 | 2,34 | 2,78 | 3,29 | 3,63 | |

| 1,8947 | 1,327 | 0,6 | 0,082 | −0,348 | −0,67 | −0,58 | −0,15 | 0,43 | 1,3 | 2 | |

| −2,14 | −1,46 | −0,69 | −0,24 | 0 | 0,104 | −0,34 | −0,4 | −0,4 | −0,3 | 0 |

Der Vergleich mit einer -Tabelle zeigt ab einen relativen Fehler unter 0,4 %, ab unter 0,1 %. Da die -Verteilung für große in eine Normalverteilung mit Standardabweichung übergeht, besitzt der Parameter aus der Tabelle, der hier frei angepasst wurde, bei der entsprechenden Wahrscheinlichkeit etwa die Größe des -fachen des Quantils der Normalverteilung (), wobei die Umkehrfunktion der Fehlerfunktion bedeutet. ⓘ

Das 95 %-Konfidenzintervall für die Varianz der Grundgesamtheit aus dem Abschnitt Beispiel kann z. B. mit den beiden Funktionen aus den Zeilen mit und auf einfache Weise als Funktion von grafisch dargestellt werden. ⓘ

Der Median befindet sich in der Spalte der Tabelle mit . ⓘ

![{\displaystyle h=\int _{0}^{\infty }f(x;\,k)\ln f(x;\,k)\,dx={\frac {k}{2}}+\ln \left[2\,\Gamma \left({\frac {k}{2}}\right)\right]+\left(1-{\frac {k}{2}}\right)\,\psi \!\left[{\frac {k}{2}}\right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d6e76f96bba0f22fdb613c4dc8c6730942ee3a79)

![{\displaystyle {\sqrt[{3}]{X/k}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8bcdb470ed5d9bcbb3a64104d190a9ff620f4048)

![{\displaystyle [0,x]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/725684c883c7ef386e8a0fe4d111e72c565747ed)